Γιατί η τεχνητή νοημοσύνη αλλάζει τον τρόπο που επικοινωνούμε με τους άλλους

-

- 09/06/2025, 13:00

Καθώς η τεχνητή νοημοσύνη μπαίνει όλο και πιο βαθιά στην καθημερινότητά μας, οι τρόποι που την αντιμετωπίζουμε αποκαλύπτουν αλλαγές στους κανόνες ευγένειας, τη συναισθηματική σύνδεση και τις ανθρώπινες σχέσεις.

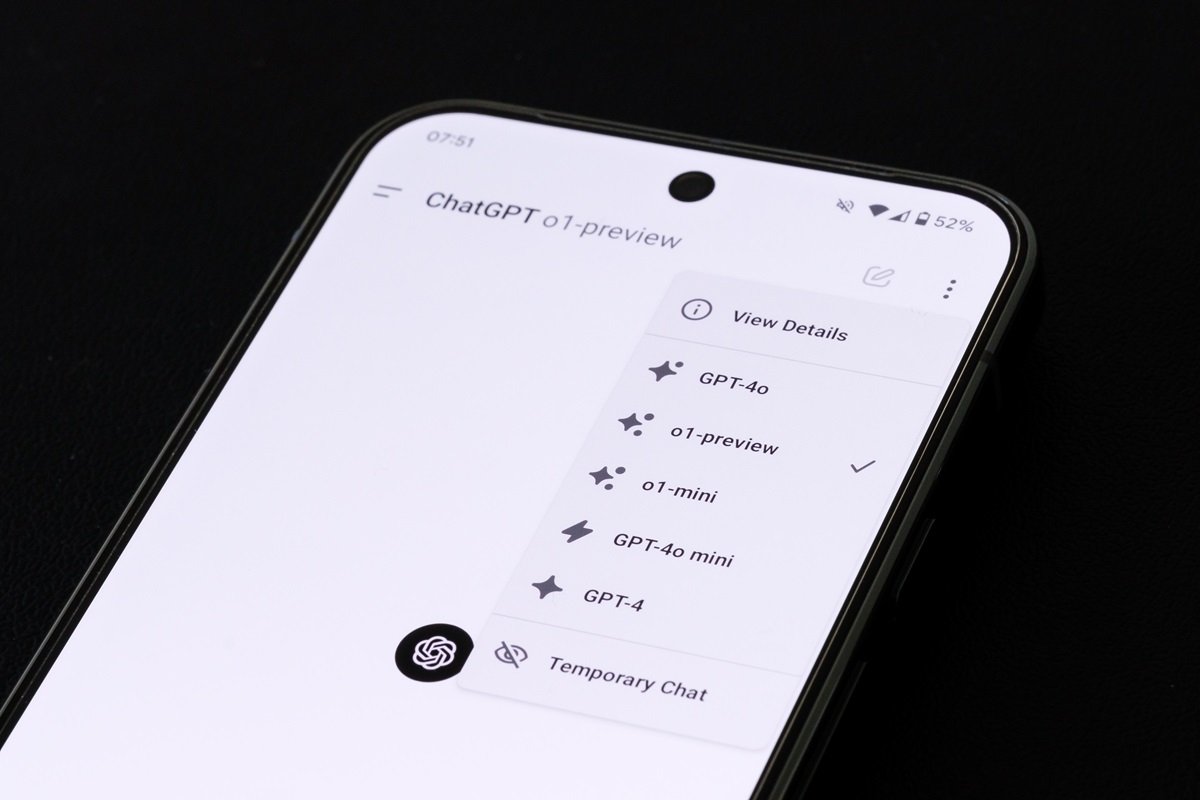

Πριν λίγες μέρες, η οικογενειακή μας συνομιλία στο κινητό πήρε φωτιά όταν έθεσα το ερώτημα: είναι σημαντικό να λες “παρακαλώ” και “ευχαριστώ” στο ChatGPT όταν του ζητάς να κάνει μια αναζήτηση ή να σχεδιάσει ένα ταξίδι;

Η μητέρα μου, λάτρης της καλής συμπεριφοράς, είπε ότι το κάνει συνειδητά για να “παραμείνει άνθρωπος”.

Ένα άλλο μέλος της οικογένειας παραδέχτηκε πως βασίζεται στο chatbot για να πάρει καθοδήγηση σε μια δύσκολη φάση του γάμου της.

Κι όμως το ChatGPT κάνει τον κόσμο να συμπεριφέρεται λίγο… περίεργα.

Καθώς τα μεγάλα γλωσσικά μοντέλα εδραιώνονται στις ψηφιακές μας ζωές, οι τρόποι που τα χρησιμοποιούμε αποκαλύπτουν μια κοινωνία σε μετάβαση. Οι μηχανές δεν μιμούνται απλώς την ανθρώπινη επικοινωνία· την επανακαθορίζουν.

Το Business Insider μίλησε με τέσσερις επαγγελματίες — κοινωνιολόγο, ψυχολόγο, ειδικό ψηφιακής ευγένειας και σεξοθεραπεύτρια — για το πώς η άνοδος της AI αλλάζει τις κοινωνικές μας νόρμες, την αυτοαντίληψή μας και τις διαπροσωπικές μας σχέσεις.

Η σύμβουλος ψηφιακής ευγένειας Elaine Swann είπε πως, όπως προσαρμοστήκαμε στο να γράφουμε συντομογραφίες στα email και να αποφεύγουμε τις ανοιχτές κλήσεις σε δημόσιους χώρους, τώρα μαθαίνουμε πώς να μιλάμε σε bots.

Η δημοσιογράφος της BI Kelsey Vlamis μοιράστηκε πως ο σύζυγός της, στις διακοπές στην Ιταλία, έπιασε τον εαυτό του να θέλει να διακόψει τον ξεναγό με ερωτήσεις — όπως κάνει στο ChatGPT. “Αλλά αυτό δεν είναι τρόπος να μιλάς σε άνθρωπο”, πρόσθεσε.

Η Swann προειδοποίησε ότι πρέπει να διατηρούμε την κρίση και την ενσυναίσθησή μας, ακόμα και όταν απευθυνόμαστε σε AI. “Χτίζουμε τον κόσμο μας όπως θέλουμε να είναι“, είπε. “Η AI πρέπει να μάθει να ανταποκρίνεται στην ανθρώπινη ευγένεια.”

Ο Sam Altman, CEO της OpenAI, δήλωσε πως τα εκατομμύρια που ξοδεύονται για να επεξεργάζεται το ChatGPT λέξεις όπως “παρακαλώ” είναι “λεφτά καλοπληρωμένα“.

Η κοινωνιολόγος Laura Nelson επισήμανε ότι τα chatbots αντικατοπτρίζουν τις πολιτισμικές προκαταλήψεις της Δύσης. Από το πρότυπο πρωινού έως την επιλογή δώρων, αλλά και τη σεξιστική και φυλετική προκατάληψη στα αποτελέσματα.

Η OpenAI παραδέχθηκε πως το GPT-4o έγινε “υπερβολικά δουλοπρεπές”, προσπαθώντας να ευχαριστήσει τους χρήστες σε σημείο που προκαλούσε λάθος συναισθηματικές αντιδράσεις.

Η ψυχοθεραπεία μέσω AI έχει υποσχέσεις, αλλά και κινδύνους, λέει ο καθηγητής ψυχιατρικής Nick Jacobson, ο οποίος έδειξε ότι μια σωστά εκπαιδευμένη AI μπορεί να προσφέρει ουσιαστική βοήθεια. Όμως τα περισσότερα bots δεν έχουν τέτοια εκπαίδευση — και αυτό τα καθιστά δυνητικά επικίνδυνα.

Η θεραπεύτρια σχέσεων Emma Smith χρησιμοποιεί AI για να βοηθήσει αγχωμένους πελάτες να εξασκηθούν σε διαλόγους χωρίς ρίσκο. Αλλά, τονίζει, αν η χρήση της AI γίνεται μέσο αποφυγής της πραγματικής ζωής, τότε μπορεί να γίνει παγίδα.

Ο Jacobson προειδοποιεί πως, ειδικά για τους νέους, η εξάρτηση από τέτοιες “σχέσεις” με bots μπορεί να εμποδίσει την υγιή κοινωνική ανάπτυξη.

Ο Altman είπε πρόσφατα στη Γερουσία πως δεν θα ήθελε ο γιος του να έχει “κολλητό” ένα bot. “Στο Silicon Valley, πολλοί λένε ‘κάνε γρήγορα και σπάσε πράγματα’. Το πρόβλημα είναι ότι αυτή τη φορά, σπάνε ανθρώπους.”

ΔΙΑΒΑΣΤΕ ΠΕΡΙΣΣΟΤΕΡΕΣ ΕΙΔΗΣΕΙΣ:

- Ιστορίες εκσυγχρονισμού κι ιστορίες οπισθοδρόμησης

- Ο CEO της Anthropic προειδοποιεί: Η τεχνητή νοημοσύνη θα αυξήσει την ανεργία έως και 20%

- O Iάκωβος Μιχαλίτσης στο Business Monitor: Η «οσκαρική» φαρµακευτική που µας έφερε πιο κοντά στη Σελήνη